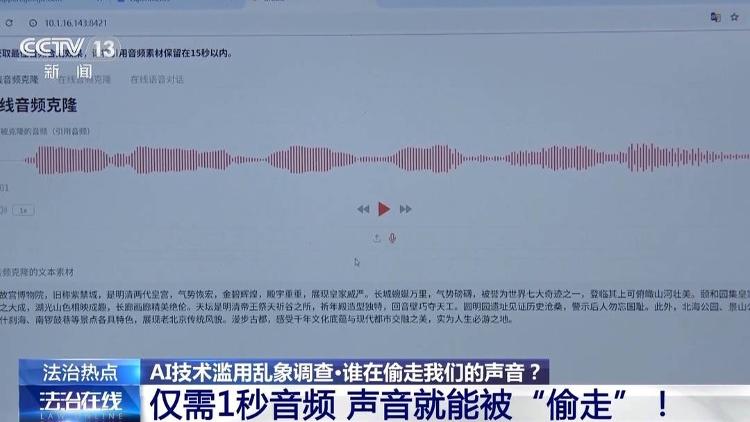

从公然盗用配音演员的声音到自由克隆名人的声音,人工智能语音泄露事件时有发生。那么目前AI技术再现声音的门槛到底有多低呢?近日,本报记者与网络安全专家进行了语音克隆实验。我们跟随记者的镜头来一探究竟。在网络安全专家的实验室,记者亲身体验了AI复制音频的全过程。在一个实验中,一名记者试图将文本的音频录制为克隆音频材料。网络安全专家卞锐彪:在拦截时,以Ripple为例,只要拦截和引用的音频内容有比较清晰的发音过程,拦截的部分应该有柔和的语气和柔和的语气,这样可以起到更好的效果。只需一秒钟,您的音频就会被“窃取”。网络安全专家随机截获一秒音频作为克隆样本。几秒钟后,j新闻记者用重复的声音朗读了之前未录制的文本。从克隆声音的音色和语调来看,与记者的原声非常相似,只有轻微的人工智能合成痕迹。网络安全专家表示,通过后期调整克隆人声音的速度和音调,可以使其更接近真人的声音,甚至是假的。目前,人工智能克隆语音不需要大量音频素材,技术核心是深度学习个体声音的表达特征。网络安全专家 潘继明:首先,只需几秒钟的音频素材,就可以学习到表达习惯、语速、语调以及个人的表达情绪,并融入到这个模型中。该模型可以通过用户请求的内容读取指定的内容来读取并执行完整的语音克隆过程。网络安全专家 Bang Ji-min 表示,随着AI语音克隆技术的使用门槛不断降低,该技术被滥用的风险也随之增加。网络安全专家潘继明:如果许多私人声音被利用,它们很可能被恶意行为者持有,并可用于敲诈勒索、情感和财务欺诈以及一些违规行为。因此,目前正在生成的这些新的录音片段需要AI标注,包括显式标注、隐式标注和水印标注。因此,平台方有责任或者义务去做这些事情。盗配配音演员声音,基于人工智能的模仿侵权行为时有发生。一秒的声音片段可以播放非常相似的声音。近年来,人工智能复音声音在多部短剧和广告中被滥用,以唱歌为生的配音演员面临失业风险,普通人的话语权面临风险。那么什么样的违规行为,这些“被盗”的声音背后隐藏着破坏和危害吗?配音演员苏彦霖:现在克隆出来了,变得很像了。这不是我录制的,但这肯定是我的音色和我的声音能力。这只是侵入性声音的冰山一角。今年早些时候,配音演员苏阳林正在网上观看一部短剧,突然听到一个听起来有些令人不安的声音。这分明是他自己的声音,但他的记忆中却从未记录过。更让苏阳林惊讶的是,抖音、小红书、红果等多个平台的众多人工智能生成的短剧、动画,其中不乏播放量过亿的热门作品,他的声音都被盗了。与苏阳林相比,配音演员刘中正的经历更具讽刺意味。 2025年12月,刘中正在录音室录制一部短片时,听到了自己从未录制过的声音。经过数次经过多轮谈判,对方当场承认错误并道歉。然而仅仅两个月后,类似的遭遇再次发生。本报记者调查发现,近年来,人工智能语音侵权克隆现象普遍存在。为哪吒配音的卢彦廷、为真晃配音的季冠霖等著名配音演员也曾被盗过声。 alg有声优在采访中表示,所属声优组中超过一半的声优都发出了自己的声音。他告诉记者,他被抄袭了。这让靠声音为生的配音演员陷入了前所未有的生存困境。检测难度大、成本高,维权难度大。面对这样的侵权行为,配音演员们的第一想法就是拿起法律武器维护自己的权益,但现实却给他们满怀希望的心泼了一盆冷水。差异举证不便、起诉途径匮乏、维权成本高昂,让很多维权人士面临胜诉也可能退钱的困境。 2025年底,安徽配音演员米子为北京某KTV网络的跨年广告录制了两句台词配音。不过,在最终的宣传视频中,原本的两句台词被改为了三句台词。额外的台词是对方使用人工智能复制自己的声音生成的。该广告还在全国 100 多家商店和多个在线平台上发布。为了维护自己的权益,米子不仅拨打了12345、12315等多个投诉举报热线,还赶赴北京寻找律师并提交了律师函。他们花了三个月的时间和大量的精力来维护自己的权利。然而,他们的维权之路却陷入了“打官司难”的死循环。症结所在问题在于,这些证据在法庭上不予采信,而且早已失去了补充证据的机会。除了高昂的经济成本之外,辩护权的取证难度更是令人望而却步。当湖南配音演员常希波发现自己的声音被克隆后,他试图在平台上投诉,却发现没有专门的投诉选项。违法零成本,保护成本高,废除容易,追究困难。攻击者的零成本与防御者的高成本形成鲜明对比。即使一些人权倡导者设法将侵权内容下架,也很难得到应有的道歉或赔偿。北京配音演员苏彦霖向红果平台投诉侵权短片后,等了一周视频才被下架,但平台未予回应。制片人这样评价先生。刘中正。我遇到过公司删除内容并承担责任的情况。对方甚至辩称,人工智能的创造并没有真人参与,因此不存在侵权。利用人工智能语音克隆的人工智能拟声诈骗案件多发,很可能被用于电信诈骗、敲诈勒索等违法活动,甚至可能引发舆论安全危机,对社会和公共秩序造成严重隐患。随着技术失去其局限性,克隆声音可能成为伤害他人的“锋利武器”。记者调查发现,人工智能复制普通人声音最直接的风险是电子欺诈。 2025年12月中旬,四川省雅安市警方破获一起人工智能拟声词诈骗案。雨城区西城派出所接到居民电话,称其父母可能是被害人。e 欺诈。通过审讯,警方获悉,事发当天下午,老人接到了克隆“孙子”的电话。对方以发生安全事故、需要立即缴纳罚款为由,骗老人提取4万元现金。幸亏警察及时赶到,才避免了老人财产的损失。无独有偶,2025年4月,湖北省黄石市也发生了三起类似的人工智能拟声词诈骗事件。犯罪分子制作了老人“孙子”的语音克隆,以需要伤害同学才能收回赎金为由,骗走了三名老人共计6万元。涉嫌非法转移资金的吴先生已被逮捕。 2025年12月,湖北省黄石市黄石港区人民法院判处吴某有期徒刑二年零一个月,并处罚金15000元。法律如何“阻止”声音ce克隆。声音作为个人生物信息极其敏感。一旦被利用,后果可能是可怕的。现有法律应如何适用于这种新型侵权问题?如何破解维权困境?如何才能从法律角度“咒骂”声音克隆技术,筑起保护公众话语权的围墙?日本民法典第1023条明确规定了与公开权相关的自然人的声音保护,这是保护声音权的基本法律依据。请注意,自然人的声音也属于《个人信息保护法》规定的特定生物识别信息范畴。侵权除了指控侵犯个人权利外,受到侵犯的人还可以从各个角度寻求权利的保护和恢复,其中包括个人信息的保护。李怀生 直接中国政法大学互联网法研究所所长:对于生物识别信息,我们的法律实际上规定了加强的特殊保护,这意味着平台必须对语音等敏感的个人生物识别信息提供加强的保护。遵守相应的保护义务也是判断平台是否承担相应侵权责任的一个非常重要的依据。针对声优涉嫌未经软件方许可将其声音输入大规模人工智能模型的“来源侵权”,法律专家明确表示,软件方的此类行为构成直接侵权,应承担相应的法律责任。中国人民大学未来法研究院执行院长张继宇:如果用大量的数据,包括他人的视听作品、音视频录音等,来进行培训未经许可在培训过程中,他人的版权及相关权也会受到侵犯。同时,如果生成的音频被用于虚假广告或误导消费者等目的。还可能存在《反不正当竞争法》和《消费者权益保护法》相关的限制。如何克服维权:高成本、低利润的困境。为了解决配音演员维权成本高、利润低的困境,法律专家建议行业团体提起集体诉讼,并引入第三方组织建立技术维权保护。同时,可以对恶意违法行为和不良社会后果实行惩罚性赔偿,增加违法者的违法成本。中国政法大学互联网法研究所所长李怀生先生:集体诉讼模式的优势行业协会的优点是可以整合相关案件的证据来降低维权成本,可以通过集体诉讼形成维权压力,可以迫使相关侵权人减少或减少相关侵权活动。中国人民大学未来法研究院执行院长 张继宇:在版权领域,可以像以往一样,鼓励社会第三方机构首先通过技术建立维权渠道。这种技术性维权不仅为相关音频权利人服务,也可以采取更先进的措施来支持平台,更好地维护网络空间秩序。专家呼吁,科技发展要坚持“以人为本、智善向善”的原则。平台必须履行主要责任,对人工智能生成的内容进行相应标记,并建立专门的语音违规报告机制渠道。软件开发者必须建立道德审查机制。我们每个人也需要提高音频维权意识。关于法治的评论:人工智能技术的创新和发展不应改变法律结果。人工智能克隆并不是突破屏障。必须严格控制滥用职权,严惩挪用公款行为,保障良好权益。 (央视新闻客户端)

从公然盗用配音演员的声音到自由克隆名人的声音,人工智能语音泄露事件时有发生。那么目前AI技术再现声音的门槛到底有多低呢?近日,本报记者与网络安全专家进行了语音克隆实验。我们跟随记者的镜头来一探究竟。在网络安全专家的实验室,记者亲身体验了AI复制音频的全过程。在一个实验中,一名记者试图将文本的音频录制为克隆音频材料。网络安全专家卞锐彪:在拦截时,以Ripple为例,只要拦截和引用的音频内容有比较清晰的发音过程,拦截的部分应该有柔和的语气和柔和的语气,这样可以起到更好的效果。只需一秒钟,您的音频就会被“窃取”。网络安全专家随机截获一秒音频作为克隆样本。几秒钟后,j新闻记者用重复的声音朗读了之前未录制的文本。从克隆声音的音色和语调来看,与记者的原声非常相似,只有轻微的人工智能合成痕迹。网络安全专家表示,通过后期调整克隆人声音的速度和音调,可以使其更接近真人的声音,甚至是假的。目前,人工智能克隆语音不需要大量音频素材,技术核心是深度学习个体声音的表达特征。网络安全专家 潘继明:首先,只需几秒钟的音频素材,就可以学习到表达习惯、语速、语调以及个人的表达情绪,并融入到这个模型中。该模型可以通过用户请求的内容读取指定的内容来读取并执行完整的语音克隆过程。网络安全专家 Bang Ji-min 表示,随着AI语音克隆技术的使用门槛不断降低,该技术被滥用的风险也随之增加。网络安全专家潘继明:如果许多私人声音被利用,它们很可能被恶意行为者持有,并可用于敲诈勒索、情感和财务欺诈以及一些违规行为。因此,目前正在生成的这些新的录音片段需要AI标注,包括显式标注、隐式标注和水印标注。因此,平台方有责任或者义务去做这些事情。盗配配音演员声音,基于人工智能的模仿侵权行为时有发生。一秒的声音片段可以播放非常相似的声音。近年来,人工智能复音声音在多部短剧和广告中被滥用,以唱歌为生的配音演员面临失业风险,普通人的话语权面临风险。那么什么样的违规行为,这些“被盗”的声音背后隐藏着破坏和危害吗?配音演员苏彦霖:现在克隆出来了,变得很像了。这不是我录制的,但这肯定是我的音色和我的声音能力。这只是侵入性声音的冰山一角。今年早些时候,配音演员苏阳林正在网上观看一部短剧,突然听到一个听起来有些令人不安的声音。这分明是他自己的声音,但他的记忆中却从未记录过。更让苏阳林惊讶的是,抖音、小红书、红果等多个平台的众多人工智能生成的短剧、动画,其中不乏播放量过亿的热门作品,他的声音都被盗了。与苏阳林相比,配音演员刘中正的经历更具讽刺意味。 2025年12月,刘中正在录音室录制一部短片时,听到了自己从未录制过的声音。经过数次经过多轮谈判,对方当场承认错误并道歉。然而仅仅两个月后,类似的遭遇再次发生。本报记者调查发现,近年来,人工智能语音侵权克隆现象普遍存在。为哪吒配音的卢彦廷、为真晃配音的季冠霖等著名配音演员也曾被盗过声。 alg有声优在采访中表示,所属声优组中超过一半的声优都发出了自己的声音。他告诉记者,他被抄袭了。这让靠声音为生的配音演员陷入了前所未有的生存困境。检测难度大、成本高,维权难度大。面对这样的侵权行为,配音演员们的第一想法就是拿起法律武器维护自己的权益,但现实却给他们满怀希望的心泼了一盆冷水。差异举证不便、起诉途径匮乏、维权成本高昂,让很多维权人士面临胜诉也可能退钱的困境。 2025年底,安徽配音演员米子为北京某KTV网络的跨年广告录制了两句台词配音。不过,在最终的宣传视频中,原本的两句台词被改为了三句台词。额外的台词是对方使用人工智能复制自己的声音生成的。该广告还在全国 100 多家商店和多个在线平台上发布。为了维护自己的权益,米子不仅拨打了12345、12315等多个投诉举报热线,还赶赴北京寻找律师并提交了律师函。他们花了三个月的时间和大量的精力来维护自己的权利。然而,他们的维权之路却陷入了“打官司难”的死循环。症结所在问题在于,这些证据在法庭上不予采信,而且早已失去了补充证据的机会。除了高昂的经济成本之外,辩护权的取证难度更是令人望而却步。当湖南配音演员常希波发现自己的声音被克隆后,他试图在平台上投诉,却发现没有专门的投诉选项。违法零成本,保护成本高,废除容易,追究困难。攻击者的零成本与防御者的高成本形成鲜明对比。即使一些人权倡导者设法将侵权内容下架,也很难得到应有的道歉或赔偿。北京配音演员苏彦霖向红果平台投诉侵权短片后,等了一周视频才被下架,但平台未予回应。制片人这样评价先生。刘中正。我遇到过公司删除内容并承担责任的情况。对方甚至辩称,人工智能的创造并没有真人参与,因此不存在侵权。利用人工智能语音克隆的人工智能拟声诈骗案件多发,很可能被用于电信诈骗、敲诈勒索等违法活动,甚至可能引发舆论安全危机,对社会和公共秩序造成严重隐患。随着技术失去其局限性,克隆声音可能成为伤害他人的“锋利武器”。记者调查发现,人工智能复制普通人声音最直接的风险是电子欺诈。 2025年12月中旬,四川省雅安市警方破获一起人工智能拟声词诈骗案。雨城区西城派出所接到居民电话,称其父母可能是被害人。e 欺诈。通过审讯,警方获悉,事发当天下午,老人接到了克隆“孙子”的电话。对方以发生安全事故、需要立即缴纳罚款为由,骗老人提取4万元现金。幸亏警察及时赶到,才避免了老人财产的损失。无独有偶,2025年4月,湖北省黄石市也发生了三起类似的人工智能拟声词诈骗事件。犯罪分子制作了老人“孙子”的语音克隆,以需要伤害同学才能收回赎金为由,骗走了三名老人共计6万元。涉嫌非法转移资金的吴先生已被逮捕。 2025年12月,湖北省黄石市黄石港区人民法院判处吴某有期徒刑二年零一个月,并处罚金15000元。法律如何“阻止”声音ce克隆。声音作为个人生物信息极其敏感。一旦被利用,后果可能是可怕的。现有法律应如何适用于这种新型侵权问题?如何破解维权困境?如何才能从法律角度“咒骂”声音克隆技术,筑起保护公众话语权的围墙?日本民法典第1023条明确规定了与公开权相关的自然人的声音保护,这是保护声音权的基本法律依据。请注意,自然人的声音也属于《个人信息保护法》规定的特定生物识别信息范畴。侵权除了指控侵犯个人权利外,受到侵犯的人还可以从各个角度寻求权利的保护和恢复,其中包括个人信息的保护。李怀生 直接中国政法大学互联网法研究所所长:对于生物识别信息,我们的法律实际上规定了加强的特殊保护,这意味着平台必须对语音等敏感的个人生物识别信息提供加强的保护。遵守相应的保护义务也是判断平台是否承担相应侵权责任的一个非常重要的依据。针对声优涉嫌未经软件方许可将其声音输入大规模人工智能模型的“来源侵权”,法律专家明确表示,软件方的此类行为构成直接侵权,应承担相应的法律责任。中国人民大学未来法研究院执行院长张继宇:如果用大量的数据,包括他人的视听作品、音视频录音等,来进行培训未经许可在培训过程中,他人的版权及相关权也会受到侵犯。同时,如果生成的音频被用于虚假广告或误导消费者等目的。还可能存在《反不正当竞争法》和《消费者权益保护法》相关的限制。如何克服维权:高成本、低利润的困境。为了解决配音演员维权成本高、利润低的困境,法律专家建议行业团体提起集体诉讼,并引入第三方组织建立技术维权保护。同时,可以对恶意违法行为和不良社会后果实行惩罚性赔偿,增加违法者的违法成本。中国政法大学互联网法研究所所长李怀生先生:集体诉讼模式的优势行业协会的优点是可以整合相关案件的证据来降低维权成本,可以通过集体诉讼形成维权压力,可以迫使相关侵权人减少或减少相关侵权活动。中国人民大学未来法研究院执行院长 张继宇:在版权领域,可以像以往一样,鼓励社会第三方机构首先通过技术建立维权渠道。这种技术性维权不仅为相关音频权利人服务,也可以采取更先进的措施来支持平台,更好地维护网络空间秩序。专家呼吁,科技发展要坚持“以人为本、智善向善”的原则。平台必须履行主要责任,对人工智能生成的内容进行相应标记,并建立专门的语音违规报告机制渠道。软件开发者必须建立道德审查机制。我们每个人也需要提高音频维权意识。关于法治的评论:人工智能技术的创新和发展不应改变法律结果。人工智能克隆并不是突破屏障。必须严格控制滥用职权,严惩挪用公款行为,保障良好权益。 (央视新闻客户端)